统计学院杨翰方老师依托校级计算服务在人工智能顶级会议发表论文

统计学院蔡宇超博士生与杨翰方老师依托校级计算服务,在人工智能顶级会议ICML 2020上发表论文:《Boosted Histogram Transform for Regression》。该论文提出了一个基于Boosting提升算法与直方图空间变换方法相结合的回归算法(称为BHTR)。以往的回归算法一般分为两类,一类以划分数据特征空间为基础,另一类以划分数据集为基础,但两类回归算法虽然尽可能地利用局部空间的数据信息,但在划分区间间隔处常常出现不连续的情况。一些学者也尝试采用ensemble集成的方法解决划分边界不连续的问题,但缺乏足够的理论支撑。在BHTR文章中,我们不仅从效果上验证了BHTR的优越性,同时说明了该种算法在简单条件约束下的理论收敛性。

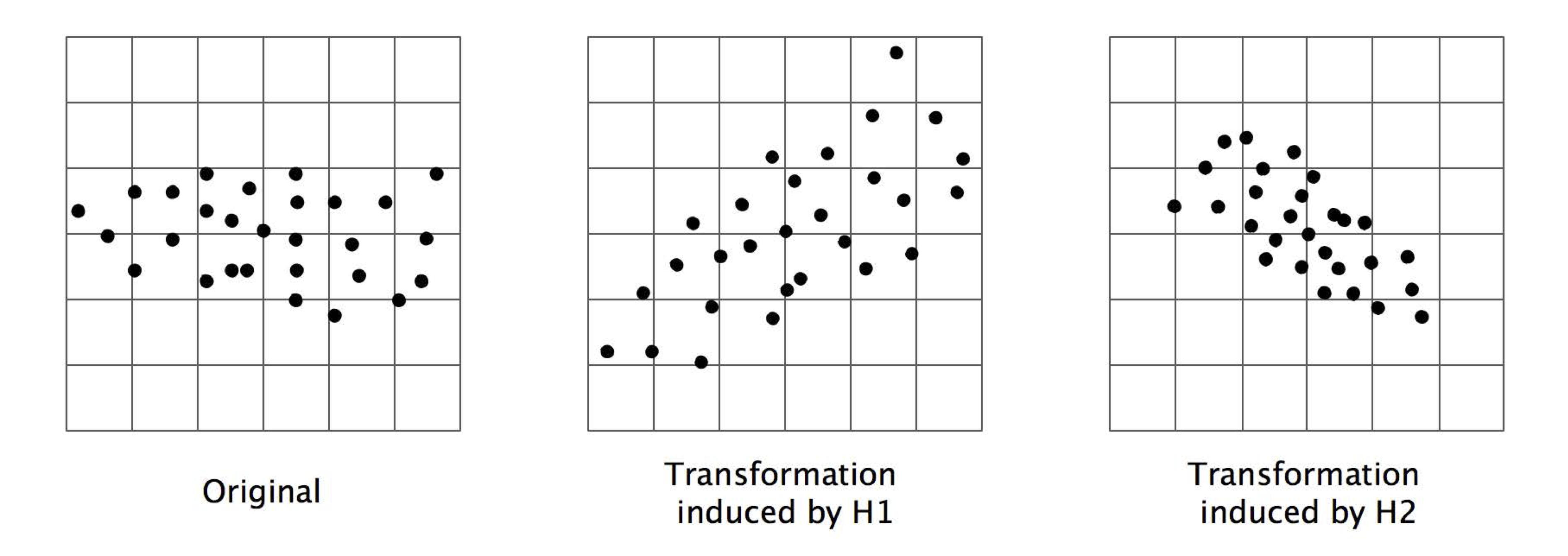

回归regression的基本问题是探索自变量与因变量之间的函数关系,而boosting提升算法作为一种重要的集成算法框架, 使用弱学习器(weak learner)在每一次迭代中修正现有模型与目标模型之间的误差,从而在学习过程中逐步提高模型的效果。我们在论文中首次将随机的直方图回归函数作为基函数,引入的随机性使得我们能够利用boosting回归算法的核心思想,在每一次迭代过程中对模型残差进行拟合,使得最终的训练模型要优于单个直方图回归的训练模型,并且我们从理论上说明了这个结果的正确性,也就是在函数空间中,BHTR的收敛速度要优于HTR(单个直方图回归模型)的收敛速度,最后我们通过设计实验说明了BHTR算法在模拟数据和真实数据中相比于其他提升算法比如提升回归树的优越性。

回归regression的基本问题是探索自变量与因变量之间的函数关系,而boosting提升算法作为一种重要的集成算法框架, 使用弱学习器(weak learner)在每一次迭代中修正现有模型与目标模型之间的误差,从而在学习过程中逐步提高模型的效果。我们在论文中首次将随机的直方图回归函数作为基函数,引入的随机性使得我们能够利用boosting回归算法的核心思想,在每一次迭代过程中对模型残差进行拟合,使得最终的训练模型要优于单个直方图回归的训练模型,并且我们从理论上说明了这个结果的正确性,也就是在函数空间中,BHTR的收敛速度要优于HTR(单个直方图回归模型)的收敛速度,最后我们通过设计实验说明了BHTR算法在模拟数据和真实数据中相比于其他提升算法比如提升回归树的优越性。

此研究成果的计算服务得到中国人民大学校级高性能与大数据公共计算云平台的支持。